삶의 공유

[Deep Learning] 수식 없이 이해하는 딥러닝 역전파(Backpropagation) 원리: AI의 오답 노트 본문

[Deep Learning] 수식 없이 이해하는 딥러닝 역전파(Backpropagation) 원리: AI의 오답 노트

dkrehd 2025. 12. 25. 22:28

🤖 인공지능이 '실수'를 통해 배우는 법: 역전파 알고리즘

인공지능이 개와 고양이를 구분하고, 복잡한 언어를 이해하는 과정을 보면 마치 살아있는 생명체처럼 느껴지기도 합니다. 하지만 그 내부를 들여다보면 정교한 수학적 오답 노트가 작동하고 있습니다. 그 핵심이 바로 오늘 소개할 역전파(Backpropagation) 알고리즘입니다.

1. 역전파 알고리즘이란 무엇인가?

역전파는 한마디로 **"출력층에서 발생한 오차를 거꾸로(Back) 전파하여, 각 층의 가중치를 얼마나 수정해야 할지 결정하는 알고리즘"**입니다.

신경망이 예측값(y^)을 내놓았을 때 실제 정답(y)과 차이가 난다면, 그 '책임'이 어느 가중치W)에 있는지 계산하여 모델을 수정하는 일종의 피드백 시스템이라고 이해하면 쉽습니다.

2. 왜 역전파를 해야 하나요?

우리의 목표는 모델의 손실 함수(Loss Function) 값을 최소화하는 가중치를 찾는 것입니다.

- 방향 찾기: 수백만 개의 가중치 중 어떤 것을 높이고 어떤 것을 낮춰야 오차가 줄어들지 알아야 합니다.

- 효율적인 수정: 역전파가 없다면 우리는 모든 가중치를 무작위로 하나씩 바꿔보는 '노가다'를 해야 하겠지만, 역전파는 미분을 통해 정확히 어느 방향으로 가야 할지를 순식간에 알려줍니다.

3. 역전파는 왜, 어떻게 등장했나요?

역전파의 역사는 딥러닝의 부활과 궤를 같이 합니다.

- 단층 퍼셉트론의 한계: 1960년대 초창기 AI는 'XOR 문제'와 같은 아주 간단한 논리 구조도 해결하지 못하는 암흑기를 겪었습니다.

- 다층 신경망의 등장: 이를 해결하기 위해 층을 여러 개 쌓았지만, 문제는 **"깊은 층에 있는 가중치들을 어떻게 학습시킬 것인가?"**였습니다.

- 1986년의 혁명: 제프리 힌튼(Geoffrey Hinton) 등이 포함된 연구팀이 역전파 알고리즘을 대중화시키면서, 아무리 깊은 층이라도 수학적으로 학습시킬 수 있는 길이 열렸습니다. 이것이 현대 딥러닝의 시초가 되었습니다.

4. 왜 딥러닝에서 유독 효과가 좋나요?

단순히 '정확해서'가 아니라, **'압도적으로 효율적'**이기 때문입니다.

- 연쇄 법칙(Chain Rule)의 마법: 역전파는 미분의 연쇄 법칙을 이용합니다. 앞 단계에서 계산된 값을 재사용하기 때문에, 층이 100층, 1000층이라도 중복 계산 없이 빠르게 기울기(Gradient)를 구할 수 있습니다.

- 대규모 파라미터 최적화: 현대 딥러닝 모델은 파라미터가 수십억 개에 달합니다. 역전파는 이 거대한 네트워크를 한 번의 연산(Backward Pass)으로 업데이트할 수 있는 유일하고 실질적인 방법입니다.

- 복잡한 지형 탐색: 비선형 활성화 함수가 섞인 복잡한 손실 함수 지형에서도, 역전파는 경사하강법과 결합하여 최적의 해(Global Minimum)를 향해 나아가는 강력한 나침반 역할을 합니다.

💡 요약하자면

역전파는 딥러닝 모델이 **"자신의 실수를 숫자로 환산하고, 그 책임을 공평하게 가중치들에게 나눠주어 다음에는 더 나은 예측을 하게 만드는 과정"**입니다. 이 알고리즘 덕분에 우리는 비로소 '깊은(Deep)' 학습을 할 수 있게 된 것입니다.

🤖 순전파, 역전파 알고리즘 파헤치기

1. 순전파 (Forward Propagation): "예측하기"

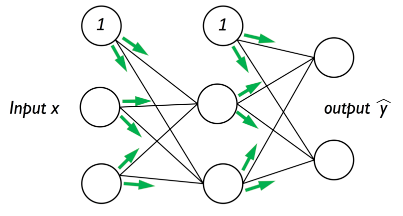

첫 번째 이미지(초록색 화살표)는 데이터가 입력에서 출력으로 흐르는 과정을 보여줍니다.

- 흐름: 입력값 x가 들어오면, 각 층의 **가중치(Weight)**와 곱해지고 **편향(Bias, 숫자 1 노드)**이 더해집니다.

- 활성화 함수: 각 노드에서는 이 계산값을 활성화 함수(예: ReLU, Sigmoid 등)를 통과시켜 다음 층으로 전달합니다.

- 결과: 최종적으로 출력층에서 예측값 y^을 만들어냅니다.

- 요약: 이 단계는 모델이 현재 알고 있는 지식을 바탕으로 **"정답이 무엇일까?"**라고 추측하는 과정입니다.

2. 역전파 (Backpropagation): "오답 노트 작성 및 수정"

두 번째 이미지(빨간색 화살표 및 수식)는 예측이 틀렸을 때, 그 책임을 뒤에서부터 앞으로 묻는 과정입니다.

Step 1 & 2: 출력층의 오차 계산

모델의 예측값(a(out)}, 즉 y^과 실제 정답(y)을 비교하여 **오차(Error)**를 구합니다.

Step 3: 출력층 가중치 업데이트를 위한 기울기(Gradient) 계산

출력층의 가중치 w가 전체 오차에 얼마나 기여했는지를 계산합니다.

Step 4: 은닉층으로 오차 전파 (The Chain Rule)

출력층의 오차를 이전 층(은닉층)으로 보냅니다. 이것이 '역전파'의 핵심입니다.

Step 5: 은닉층 가중치 업데이트를 위한 기울기 계산

은닉층의 오차(∂(h))와 입력값(a(in))을 사용하여 가중치 수정량을 결정합니다.

🔗 1. 연쇄 법칙(Chain Rule)이란 무엇인가?

연쇄 법칙은 합성 함수의 미분법입니다. 여러 개의 함수가 층층이 쌓여 있을 때, 가장 바깥쪽의 변화가 가장 안쪽의 변수에게 어떤 영향을 미치는지 계산하는 규칙입니다.

💡 일상 속의 비유

당신이 자전거를 타고 있다고 가정해 봅시다.

- 당신이 페달을 1바퀴 돌리면, 체인이 2바퀴 돕니다.

- 체인이 1바퀴 돌면, 바퀴는 3바퀴 구릅니다.

그렇다면 "내가 페달을 1바퀴 돌릴 때, 바퀴는 몇 바퀴 구를까요?" 답은 $2 \times 3 = 6$바퀴입니다. 이처럼 각 단계의 변화율(미분값)을 곱해서 최종 변화량을 구하는 것이 바로 연쇄 법칙의 핵심입니다.

📐 2. 수식으로 보는 연쇄 법칙

함수 z = f(y)가 있고, y = g(x)라고 할 때, x에 대한 z의 변화량(미분)은 다음과 같이 각 단계 미분의 곱으로 표현됩니다.

이 수식이 의미하는 바는 **"중간 단계(y)의 연결 고리를 이용해 끝에서 끝(x → z)까지의 영향을 계산할 수 있다"**는 것입니다.

🧠 3. 딥러닝 신경망에서의 적용

딥러닝 모델은 수많은 층(Layer)이 겹겹이 쌓인 거대한 합성 함수입니다. 하나의 뉴런에서 일어나는 일을 연쇄 법칙으로 분해해 보겠습니다.

가상의 신경망 구조

- 입력($x$)과 가중치($w$)의 결합: z = w · x + b

- 활성화 함수 통과: a = δ(z)

- 오차(Loss) 계산: L = (a - y_(target))^2

우리가 알고 싶은 것은 "가중치 w를 아주 조금 바꿨을 때, 최종 오차 L은 얼마나 변할까?" 즉,

입니다.

연쇄 법칙의 전개

가중치 w에서 오차 L까지 가려면 여러 단계를 거쳐야 하므로, 이를 거꾸로 하나씩 곱해 내려옵니다.

- 1단계: "출력값(a)이 변하면 오차(L)는 어떻게 변하는가?"

- 2단계: "입력 총합(z)이 변하면 출력값(a)은 어떻게 변하는가?"

- 3단계: "가중치(w)가 변하면 입력 총합(z)은 어떻게 변하는가?"

이 값들을 모두 곱하면, 우리는 아주 깊은 곳에 있는 가중치 w가 최종 오차에 미치는 영향력을 정확히 알 수 있게 됩니다.

🚀 4. 왜 딥러닝에서 연쇄 법칙이 그토록 강력한가?

① 계산의 효율성 (Dynamic Programming)

신경망이 100층이라고 가정할 때, 모든 가중치에 대해 처음부터 끝까지 새로 미분하는 것은 엄청난 낭비입니다. 연쇄 법칙을 사용하면 이전 단계에서 계산된 미분값을 다음 단계에서 그대로 재사용할 수 있습니다. 이를 통해 계산 복잡도를 획기적으로 낮춥니다.

② "로컬" 정보만으로 충분함

각 노드(뉴런)는 전체 네트워크의 구조를 몰라도 됩니다. 오직 자신에게 들어오는 값과 자신이 내보내는 값 사이의 미분값만 계산해서 뒤로 넘겨주면 됩니다. 이 로컬 정보들이 '체인'처럼 연결되어 전체 시스템을 최적화하게 됩니다.

③ 기울기 소실(Vanishing Gradient)의 원인

반대로, 연쇄 법칙 때문에 문제가 생기기도 합니다. 미분값들을 계속 곱해 나가다 보니, 만약 중간 단계의 미분값이 0.1처럼 작다면 층이 깊어질수록 최종 결과값이 0에 가까워져 학습이 안 되는 현상이 발생합니다. 이를 이해하는 바탕도 바로 연쇄 법칙입니다.

💡 요약하자면

연쇄 법칙은 **"복잡한 문제를 작은 단위의 미분으로 쪼개고, 이를 다시 곱해서 전체의 해답을 찾는 과정"**입니다. 이 법칙 덕분에 우리는 아무리 거대한 인공신경망이라도 수학적으로 정확하고 빠르게 학습시킬 수 있습니다.

3. 역전파 알고리즘 핵심 요약: 왜 이 과정을 거치나요?

역전파의 목적은 결국 **경사하강법(Gradient Descent)**을 수행하여 모델을 최적화하는 것입니다.

- 오차의 책임 추궁: 뒤에서부터 앞으로 가며 각 가중치가 오차에 기여한 정도를 미분으로 계산합니다.

- 가중치 수정: 계산된 기울기(Gradient) 방향으로 가중치 W를 조금씩 업데이트합니다.

- 반복: 이 과정을 수만 번 반복하면 모델의 예측값 y^은 실제 정답 y에 점점 가까워집니다.

팁: 역전파는 **연쇄 법칙(Chain Rule)**을 이용해 복잡한 합성 함수의 미분(손실 함수 $J$에 대한 가중치 편미분)을 효율적으로 수행하는 알고리즘입니다.

🤖 신경망 수렴

1. 학습 방식별 비교: 어떻게 내려올 것인가?

학습 데이터 전체를 한 번에 볼 것인지, 아니면 조금씩 나누어 볼 것인지에 따라 크게 세 가지로 나뉩니다.

① 기본 경사 하강법 (Batch Gradient Descent)

모든 학습 데이터셋을 한꺼번에 사용하여 기울기(Gradient)를 계산합니다.

- 특징: 전체 데이터를 다 본 뒤에 가중치를 딱 한 번 업데이트합니다.

- 장점: 경로가 매우 매끄럽고 안정적으로 수렴합니다.

- 단점: 데이터가 수백만 건이라면 한 번 업데이트하는 데 시간이 너무 오래 걸리고 메모리 부족(OOM) 문제가 발생할 수 있습니다.

② 온라인 학습 방식 (Stochastic Gradient Descent, SGD)

매 스텝마다 딱 하나의 데이터만 무작위로 골라 기울기를 계산합니다.

- 특징: 업데이트가 매우 빈번하며, 경로가 마치 '술 취한 사람'처럼 심하게 요동치며 내려갑니다.

- 장점: 계산 속도가 매우 빠르고, 이미지 속의 **Local cost minimum(지역 최솟값)**에 갇혔을 때 요동치는 힘으로 튕겨 나와 Global minimum으로 향할 가능성이 있습니다.

- 단점: 최솟값 근처에 도달해도 멈추지 않고 주변을 계속 배회할 수 있습니다.

③ 미니배치 방식 (Mini-batch Gradient Descent)

데이터를 적당한 크기(예: 32, 64, 128개)로 묶어 처리하는 방식으로, 현재 딥러닝에서 가장 표준적으로 사용됩니다.

- 특징: GD의 안정성과 SGD의 속도라는 장점을 적절히 섞었습니다.

- 장점: GPU의 병렬 연산 기능을 최대한 활용할 수 있어 효율적이며, 적당한 노이즈가 있어 지역 최솟값을 피하는 데 도움을 줍니다.

2. 수렴의 핵심 난관

이미지에서 볼 수 있듯이, 수렴 과정에는 큰 방해 요소가 있습니다.

- Local Cost Minimum (지역 최솟값): 산을 내려오다 만난 작은 웅덩이입니다. 모델은 여기가 최저점인 줄 착각하고 멈출 수 있습니다.

- Global Cost Minimum (전역 최솟값): 우리가 진짜 목표로 하는 가장 깊은 골짜기입니다.

- Random Initial Condition: 처음에 공을 어디서 떨어뜨리느냐에 따라 도달하는 결과가 달라질 수 있습니다.

[!NOTE]

최근의 딥러닝 연구에 따르면, 고차원 신경망에서는 지역 최솟값보다 안장점(Saddle Point)—한쪽으로는 내려가지만 다른 쪽으로는 올라가는 지형—에 갇히는 것이 더 큰 문제로 지적되기도 합니다.

3. 한눈에 보는 비교표

| 구분 | 데이터 사용량 | 수렴 속도 (1회 업데이트 기준) | 안정성 | 특징 |

| Batch GD | 전체 데이터 | 매우 느림 | 높음 | 정확하지만 무겁고 느림 |

| SGD (Online) | 1개 | 매우 빠름 | 낮음 (요동침) | 지역 최솟값 탈출에 유리 |

| Mini-batch | 지정한 묶음 단위 | 빠름 | 보통 | 현재 딥러닝 표준 |

다층 신경망(Deep Neural Networks)처럼 파라미터가 수백만 개에 달하고 데이터셋이 방대한 복잡한 모델에서는 **미니배치 경사 하강법(Mini-batch Gradient Descent)**을 기반으로 한 **적응형 최적화 알고리즘(Adaptive Optimization Algorithms)**을 주로 사용합니다.

단순히 "내려가는 것"을 넘어, "얼마나 빠르게, 어떤 방향으로" 내려갈지를 수학적으로 정교하게 계산하는 방식들입니다.

1. 왜 미니배치 방식을 선택할까?

복잡한 모델일수록 아래 두 가지 이유 때문에 미니배치 방식이 강제됩니다.

- 메모리 한계: 수 기가바이트(GB)에 달하는 전체 데이터를 한 번에 GPU 메모리에 올리는 것은 불가능합니다(Batch GD의 한계).

- 병렬 연산의 효율성: 현대의 GPU는 여러 데이터를 동시에 처리하는 데 특화되어 있습니다. 미니배치(예: 32, 64, 128개) 단위로 계산할 때 하드웨어 성능을 최대로 끌어낼 수 있습니다.

2. 복잡한 모델에서 사용하는 핵심 기술: "Optimizer"

단순한 경사 하강법은 복잡한 지형(Local Minimum, Saddle Point)에서 길을 잃기 쉽습니다. 이를 해결하기 위해 실제 현업에서는 다음과 같은 발전된 알고리즘을 결합합니다.

① 관성을 이용하는 '모멘텀(Momentum)'

- 원리: 가던 방향으로 계속 가려는 성질을 이용합니다.

- 효과: 경사가 완만한 곳에서도 빠르게 이동하고, 작은 지역 최솟값(Local Minimum)을 관성의 힘으로 통과할 수 있게 돕습니다.

② 보폭을 조절하는 '적응형 학습률(Adaptive Learning Rate)'

- RMSProp / Adagrad: 많이 변한 파라미터는 보폭을 줄이고, 적게 변한 파라미터는 보폭을 넓혀서 모든 파라미터가 골고루 학습되게 합니다.

- Adam (Adaptive Moment Estimation): 현재 딥러닝에서 가장 많이 쓰이는 방식입니다. 모멘텀의 '관성'과 RMSProp의 '보폭 조절' 장점을 합친 알고리즘입니다.

'Data Scientist > ML' 카테고리의 다른 글

| [Deep Learning] 밑바닥부터 시작하는 다층 인공 신경망(MLP) 구현하기: MNIST 실습 (0) | 2025.12.11 |

|---|---|

| 정답 없는 데이터에서 보물을 찾아라! 머신러닝 군집 분석 (Cluster Analysis) 완벽 가이드 🗺️ (0) | 2025.12.09 |

| 선형 회귀의 한계를 넘어서: 다항 회귀와 랜덤 포레스트로 비선형 데이터 정복하기 (0) | 2025.12.02 |

| 회귀 분석으로 주택 가격 예측하기 — 단순 회귀부터 RANSAC까지 한 번에 이해하기 (0) | 2025.11.18 |

| [실전프로젝트] IMDb 영화 리뷰 감성 분석(2편) - 로지스틱 회귀 최적화 & 대용량 온라인 학습 (0) | 2025.10.27 |